HAI-Lab Research

Demo Systems

Research Topics

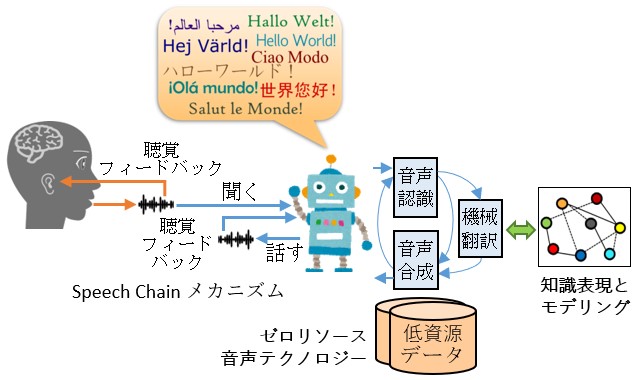

多感覚コミュニケーションAI

自然なコミュニケーションには、聴覚と視覚だけでなくそれらの相互作用も含まれます。本研究は、聴いたり、話したり、あるいは話しながら聴くことや、見ることを可能にするコミュニケーションのメカニズムの開発に焦点を当てています。これには、音声認識(ASR)、音声合成(TTS)、画像キャプショニング(IC)、画像生成(IG)、多言語・多話者・多様な形のマシンスピーチチェインも含まれます。またコードスイッチング、感情のニュアンス、自然な会話の文脈、逐次的言語処理、ダイナミックなドメイン適応を包括しています。

空間知能統合型言語AI

自然言語処理技術を基盤とするAIシステムの言語知能に着目し、その方法論を探究します。たとえば、リアルタイムの言語理解、コンテキストに敏感な言語生成、および音声から音声への直接翻訳をカバーする人間のような同時音声翻訳が含まれます。また、AIシステムの空間知能についても探究します。たとえば、地理空間に関する分析や、自然言語処理技術と地理情報システム(Geographic Information Systems)の統合などがあります。これにより、言語だけでなく、実世界の地理空間についても高度に思考できるAIシステムの実現を目指します。

多様な形のインタラクティブAI

人間と機械の相互作用を高めるためのさまざまな技術を探究します。たとえば、インタラクティブなアバターや遠隔臨場感システム、知的な対話システム、ビューシェアリングシステムの開発、VR / AR技術の統合などが含まれます。新しいインターフェースとモダリティの探求により人間の認知と機械学習能力についての深い理解に貢献します。

表現学習と発達型AI

研究領域としては、人間のような学習プロセスに着想を得たディープラーニング技術にも焦点を当てます。これには、乳幼児の学習のエミュレーションとしてのゼロ資源音声技術や、教師なし/教師あり学習、および低計算資源のためのモデル・パラメータ削減、継続学習、自己認識及び自己改善メカニズムが含まれます。また、性能改善のための転移学習と知識蒸留の手法も探求します。このように多様なデータ資源と言語を効率的に処理するための多様なモダリティと多言語の能力を強調した汎用的な情報表現のモデリングに取り組みます。

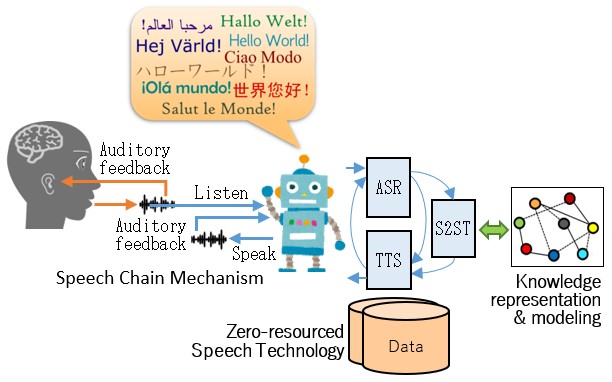

Multisensory Communicative AI

Natural communication involves not only auditory and visual sensory systems but also their interaction. The research focuses on developing technologies enabling communication mechanisms to listen, speak, and listen while speaking and visualizing. This includes advancements in automatic speech recognition (ASR), text-to-speech synthesis (TTS), image retrieval (IR), image generation (IG), and machine speech chains in a multilingual, multimodal, multi-talker fashion. This encompasses linguistic code-switching, emotional nuances, spontaneous conversational context, incremental processing, and dynamic adaptation.

Spatial intelligence integrated language AI

The research emphasizes the comprehensive nature of the AI system's linguistic capabilities involved in natural language processing, including real-time language understanding, context-aware language generation, and human-like simultaneous speech translation that directly translates from speech to speech in real time, covering both linguistic and paralinguistic information. Additionally, it focuses on the integration of geospatial capabilities for geographical context analysis and interpretation, thus expanding the AI system's capabilities to include not only linguistic understanding but also location-aware context comprehension.

Diverse Interactive AI

The research encompasses a wide range of technologies to enhance interaction between humans and machines. This includes developing interactive avatars and tele-existence systems, intelligent dialog systems, view-sharing systems, and integrating VR/AR technologies to create seamless and immersive interactions and collaborations. Moreover, the exploration of new interfaces and modalities contributes to a deeper understanding of human cognition and machine learning capabilities in interactive environments.

Representation Learning and Developmental AI

The research area focuses on deep learning techniques inspired by human-like learning processes. This includes zero-resourced speech technology for infant learning emulation, unsupervised/semi-supervised learning, and model complexity reduction for low-computational resources, as well as never-ending learning, self-awareness and self-improvement mechanism. Additionally, it explores transfer learning and knowledge distillation for task improvement. The research also delves into universal information representation modeling, emphasizing multimodal and multilingual capabilities for efficient processing of diverse data sources and languages by AI systems.